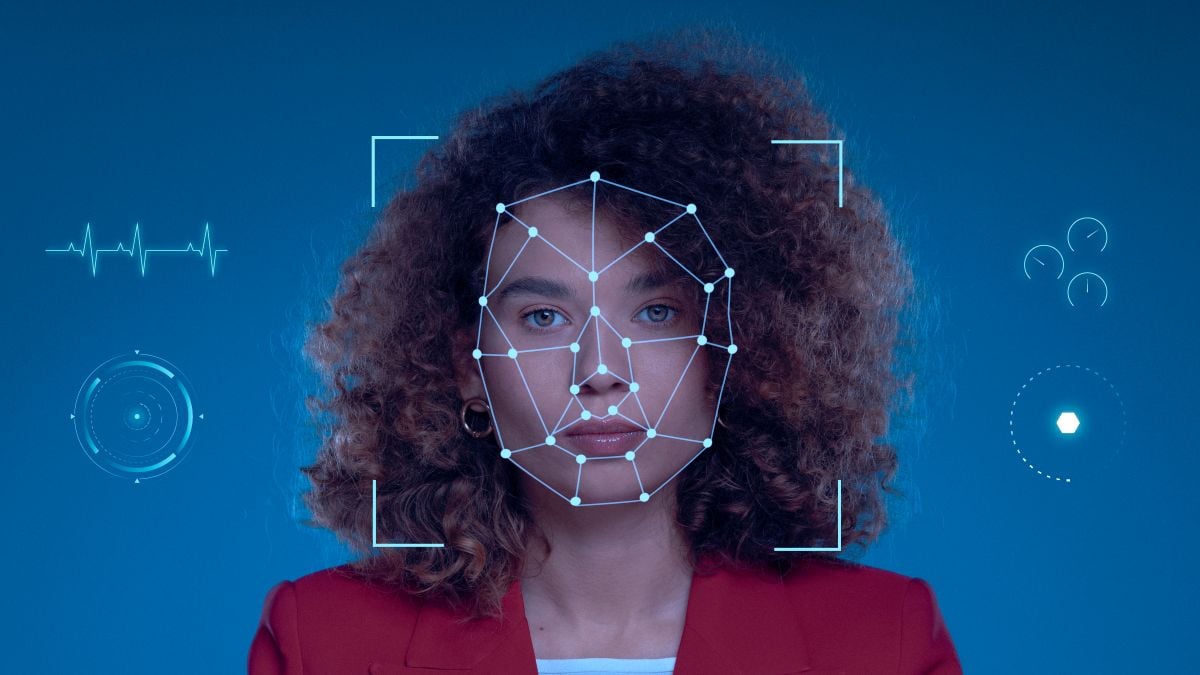

Separados, los deepfakes y la ingeniería social son considerados dos de las herramientas más usadas por los cibercriminales en la actualidad. Sin embargo, cada vez más se están articulando como parte de sofisticados ataques contra las organizaciones. ¿Cómo se están usando y por qué?

En el fondo, deepfakes e ingeniería social siempre han estado unidos por un sentido narrativo con fines criminales. Esto ha sido explotado por los ciberdelincuentes en su afán de vulnerar las defensas de organizaciones, empresas y gobiernos. Pero ¿cuándo comenzó esta historia? Para responder a esta inquietud, empecemos con el más sofisticado de la dupla.

El término «Deepfake» no nació del ingenio de los investigadores ni de las autoridades, sino de los propios criminales. En 2017, en Reddit se utilizó el nombre deepfakes en videos pornográficos con tecnología de intercambio de rostros para superponer caras de famosos en cuerpos de otras personas.

La palabra en sí es una combinación de «deep learning«, la tecnología de IA utilizada para crear los videos, y «fake» o falso. Aunque el subreddit original fue eliminado, el término ganó popularidad y, desde entonces, es ampliamente reconocido para cualquier forma de medio sintético creado con IA.

Es más, algunos deepfakes ni siquiera utilizan video. Como muestra, en 2019, el CEO de una empresa energética inglesa perdió 243.000 dólares cuando un estafador se hizo pasar por su jefe. La estafa solo se descubrió cuando la empresa en Hungría solicitó un segundo pago.

Una conocida de siempre: la ingeniería social

Contrario a lo que muchos creerían, el término «ingeniería social» se refería originalmente a algo positivo. De hecho, fue acuñado por el filántropo holandés Jacob Cornelis van Marken en 1894 para referirse a la intervención profesional orientada a mejorar las estructuras sociales y la relación entre el capital y el trabajo en las empresas.

Una intención parecida a la que tenía el conocido filósofo Karl Popper cuando, en 1945, introdujo el término para referirse al uso de elementos sociológicos y psicológicos con el fin de mejorar sociedades. Pero fue hasta 1970 que el sentido de estas palabras varió hacia lo que conocemos en la actualidad.

Según el Instituto de Estándares Estadounidense (NIST), la ingeniería social puede ser definida como «el acto de engañar a una persona para que revele información confidencial, obtener acceso no autorizado o cometer fraude, asociándose con la persona para ganarse su confianza».

Un trabajo en equipo

Aunque los deepfakes se dieron a conocer en 2017, los primeros usos en crímenes provienen precisamente de 2019, cuando eran usados en campañas entrelazadas con ingeniería social, y es que esta última más que una tecnología es una estrategia de seducción y engaño.

Un ataque de ingeniería social con deepfakes no es un incidente aislado, sino una campaña coordinada basada en la obtención de información para construir una narrativa creíble. Los atacantes explotan la confianza de las personas y su predisposición a obedecer a figuras de autoridad, lo que hace que los ataques sean más efectivos.

Y peor aún, cada día son más sofisticados. Un estudio indicó que solo el 0.1% de los participantes pudo distinguir con precisión el contenido real del deepfake. Las personas tienden a sobreestimar sus propias habilidades de detección y son más propensas a confundir deepfakes con contenido auténtico. Por ello, basar la defensa en la capacidad de los empleados para detectar deepfakes se considera una estrategia con un resultado no favorable.

¿Cómo combatirlos?

La defensa contra los deepfakes y los ataques de ingeniería social debe centrarse en la verificación y en los protocolos basados en procesos claros. Así, en lugar de entrenar a las personas para que identifiquen un deepfake, el objetivo es educarlas para que sigan los procedimientos establecidos.

Es más, las organizaciones pueden implementar simulacros para evaluar las vulnerabilidades en los flujos de trabajo y controles de seguridad de la empresa. Además de las medidas centradas en los procesos, se recomienda implementar métodos estrictos como la autenticación multifactor (MFA) y validaciones multicanal antes de operaciones sensibles.

Y por supuesto, se debe usar tecnología, pues ya existen soluciones de IA que analizan imágenes, audios y videos para detectar los deepfakes. Están, por ejemplo, Sensity, Deepware, DuckDuckGoose, algoritmos de desincronización audio-labial.

Además, es fundamental incluir una filosofía que comience por la desconfianza (Zero Trust) enseñando que, si algo parece muy bueno para ser cierto, es por algo.

Si quieres saber cómo desde Movistar Empresas te podemos ayudar a impulsar la transformación de tu negocio y a hacerlo de manera sostenible ingresa aquí.

Foto de Freepik